Politycy w Polsce używają nie tylko botów. Powszechnie wykorzystywane są też inne internetowe narzędzia, a głównym problemem jest ich niejawność. Nie mamy pojęcia, że ulegamy wpływowi fake’owych kont, kupionych lajków czy automatycznie generowanych wpisów. Potrzebujemy przejrzystości i prawnych regulacji social mediów, by skończyć z manipulowaniem wyborcami.

Dowód na użycie botów, czyli automatycznych kont tworzących wpisy, w kampanii prezydenckiej Andrzeja Dudy opublikowały w piątek Gazeta Wyborcza i Radio Zet. Dziennikarze Wojciech Czuchnowski i Mariusz Gierszewski znaleźli w dokumentach Państwowej Komisji Wyborczej załącznik do umowy zawartej przez Komitet Wyborczy Dudy, w którym zapisano, że firma ma co miesiąc stworzyć tysiąc wątków tematycznych i dokonać 5 tys. wpisów automatycznych, za każdy otrzymując 2 zł. Pod umową znajduje się pieczęć i podpis pełnomocnika finansowego komitetu wyborczego. Umowę zawarto ze spółką ELCHUPACABRA. Jej właścicielami było dwóch asystentów posła PiS Adama Bielana.

Ta informacja wywołała burzę. Adam Bielan stwierdził, że umowa dotyczyła moderowania strony internetowej andrzejduda.pl (taki adres znajduje się w umowie), a nie używania botów, ale jednocześnie zaznaczył, że sam nie brał udziału w kampanii. Rzecznik prezydenta Błażej Spychalski zapewnił, że w kampanii Andrzeja Dudy nie podejmowano żadnych nieetycznych działań, a sam prezydent w sobotę na Twitterze napisał, że informacje medialne nt. botów to „typowy fake news”. Jednak treść opisanego załącznika jest jasna. Wpisy automatyczne nie mogą oznaczać nic więcej jak właśnie użycie botów – bo boty to konta generujące automatyczne reakcje lub komentarze w sieci.

Mamy twardy dowód

Oczywiście, wpisy mogły pojawiać się w różnych miejscach: w określonych mediach społecznościowych, na forach albo np. na stronie andrzejduda.pl. Niezależnie od miejsca 5 tys. wygenerowanych sztucznie komentarzy miesięcznie musiało mieć wpływ na wizerunek kandydata – lub jego przeciwnika, nie wiemy przecież, jaka była treść wpisów.

Nawet gdyby więc przyjąć wyjaśnienia za dobrą monetę i uznać, że wszystkie automatyczne wpisy pojawiały się na witrynie kandydata – także wtedy oddziaływały one na poglądy wyborców, nieświadomych, że czytają opinie nie prawdziwych ludzi, lecz sztucznych kont, i że opinie te zostały przygotowane przez firmę współpracującą ze sztabem wyborczym.

Najistotniejsze nie jest jednak to, gdzie automatyczne wpisy się pojawiały, tylko fakt, że mamy wreszcie twardy – inny niż analiza sieci – dowód na użycie płatnych sztucznych kont w kampanii.

Warto pamiętać, że mówimy o 2015 roku, kiedy to po raz pierwszy na tak dużą skalę w polskiej polityce wykorzystano tego typu narzędzia internetowe. Do ich stosowania przygotowany był sztab Dudy, nie był natomiast – sztab Komorowskiego. Nic nie wiedzieli o nich również wyborcy – i to jest najistotniejsze. O tym, jak wpływają na użytkowników sieci boty, mieliśmy się dowiedzieć dopiero rok później, po ujawnieniu praktyk internetowych w kampanii Trumpa. Dziś nikt nie jest więc w stanie ocenić, w jakim stopniu automaty wpłynęły na wynik polskich wyborów prezydenckich. Wiadomo jednak, że swoją rolę w zniechęcaniu wyborców do Bronisława Komorowskiego odegrało wyśmiewanie jego zachowań, mocno nakręcane właśnie w mediach społecznościowych.

Trolle: milionowe zasięgi w ciągu kilku godzin

Ale konta automatyczne to tylko jedno z kilku używanych narzędzi. Innym są konta trollerskie, zorganizowane w duże grupy, mające swoich koordynatorów. Ich celem jest sianie hejtu i ośmieszanie konkretnych akcji, wpisów czy ludzi. Trolli używał zarówno PiS, jak i PO – do czego przyznała się w 2015 roku premier Ewa Kopacz. Była to wówczas reakcja PO na działania PiS-u w kampanii prezydenckiej. Grupy trollerskie działające po prawej stronie działają jednak do dziś, i są na tyle dobrze zorganizowane, że potrafią w ciągu kilku godzin, przy wsparciu prawicowych portali informacyjnych, wygenerować na Twitterze akcję, która dociera do miliona użytkowników. Jedną z ostatnich była sytuacja, gdy na Twitterze pojawił się filmik z Rafałem Trzaskowskim, kandydatem Koalicji Obywatelskiej (PO i .N) na prezydenta Warszawy, mocującym prowizorycznie szybę do drzwi za pomocą taśmy klejącej. Film był powszechnie obśmiewany, ale po jakimś czasie prawa strona stworzyła hashtag #RobotaRafała – i to właśnie on w ciągu dwóch godzin zdobył milionowy zasięg na Twitterze. W szczycie aktywności tweety z hashtagiem pojawiały się co kilkanaście sekund. To samo działo się w przypadku hashtagu #ACTA2 – prawa strona wykorzystała go do uderzenia w Platformę, w szczytowym momencie tweety pojawiały się z częstotliwością 42 wpisów na minutę.

Czy podczas takich akcji wykorzystywane są boty? Możliwe. Boty służą przede wszystkim do rozpowszechniania określonych treści w sieci. Generują niskie zasięgi (ponieważ zazwyczaj nikt takich kont nie obserwuje albo są to nieliczni użytkownicy), ale za to wysokie liczby reakcji pod postem. A to jest sygnał dla algorytmów obsługujących media społecznościowe, by promować angażujący wpis, pokazując go większej liczbie użytkowników. Boty można wykorzystać również do zamieszczania automatycznych wpisów czy komentarzy. Z reguły są one podobne do siebie, mało finezyjne w treści – ale wpływają już nie tylko na algorytmy, ale też na psychikę czytelników.

Uruchamia się wówczas tzw. zasada społecznego dowodu słuszności, opisana przez znanego włoskiego psychologa Roberta B. Cialdiniego: kiedy nie wiemy, jak się zachować, kierujemy się tym, co robi większość. Dlatego najłatwiej jest nam zareagować na wpis tak samo, jak inni. Im więcej osób uważa jakiś wpis za wartościowy, tym chętniej do nich dołączymy.

A jeśli zobaczymy dużo komentarzy krytycznych, obśmiewających post czy osobę, też chętnie przyjmujemy to samo zdanie, głównie po to, by poczuć się bezpiecznie i komfortowo. Automatycznie generowane, sztuczne wpisy, podobnie jak trolle, mogą w ten sposób wpływać na nasz sposób myślenia np. o konkretnym kandydacie.

500 tweetów dziennie – boty na politycznych usługach

W 2015 roku boty były nowością w polskiej polityce. Dziś są powszechnym narzędziem. Choć polscy politycy twierdzą, że ich nie używają, tak naprawdę korzysta z nich wiele ugrupowań. Niektórzy politycy kupują też komercyjne lajki czy fanów, by poprawić swój wizerunek w mediach społecznościowych. W użyciu są także lajki ukryte, czyli takie, które podnoszą liczbę reakcji pod wpisem, ale same pozostają niewidoczne. To też służy oddziaływaniu na algorytmy.

Przykładem bota opozycyjnego jest konto „Witold Głogowski”. Istnieje przynajmniej siedem kont o nieco różniących się od siebie nazwach, ale założonych na to samo nazwisko.

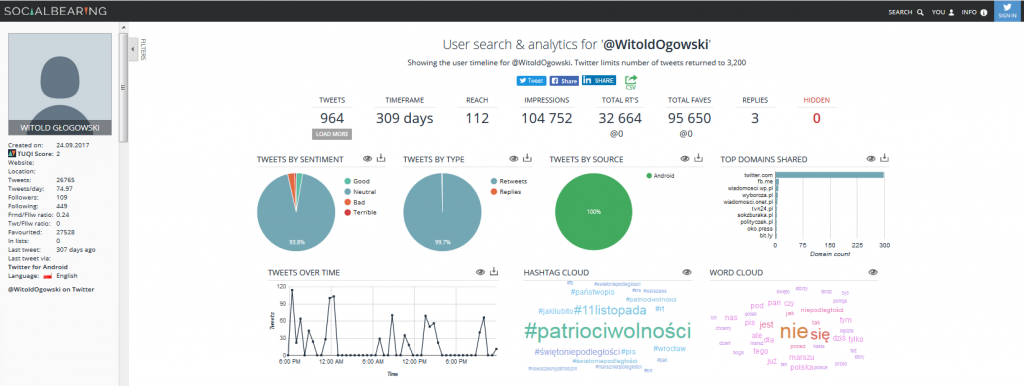

Konta były aktywne w różnych okresach, obecnie są nieużywane – ale łatwo na przykładzie jednego z nich zaobserwować sposób działania botów. Konto @WitoldOgowski działało – jak wynika z analizy dokonanej za pomocą narzędzia Social Bearing – od 24 września 2017 roku. Jego ostatni tweet pochodzi z 12 listopada 2017. Przez 49 dni konto wygenerowało 26765 tweetów, z czego 99 proc. to były retweety, czyli wpisy podane dalej – to bardzo charakterystyczna struktura dla botów, które nie tworzą własnych treści. Oznacza to, że dziennie ten bot podawał dalej 546 tweetów. Po czym zamilkł i dziś jest to konto nieaktywne.

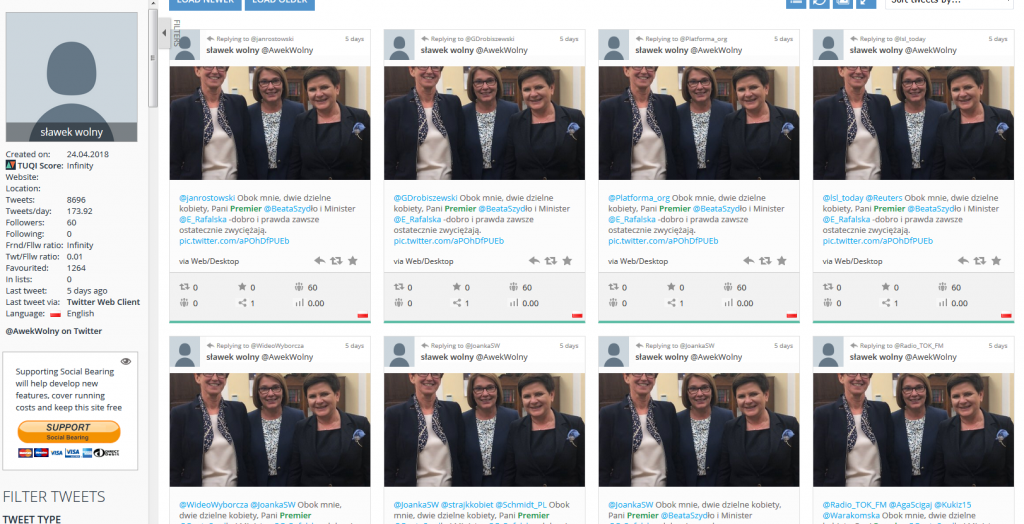

Na rzecz prawej strony działało natomiast choćby konto @AwekWolny, już nieistniejące, które opisywałam w czerwcu w artykule na temat botów aktywnych podczas kampanii prezydenckiej w Warszawie. Było charakterystyczne, bo (jak widać na poniższych screenach) m.in. wielokrotnie publikowało te same treści lub zdjęcia, o treści anty-opozycyjnej oraz korzystnej dla PiS. Dziennie tworzyło w ten sposób średnio 173 tweety.

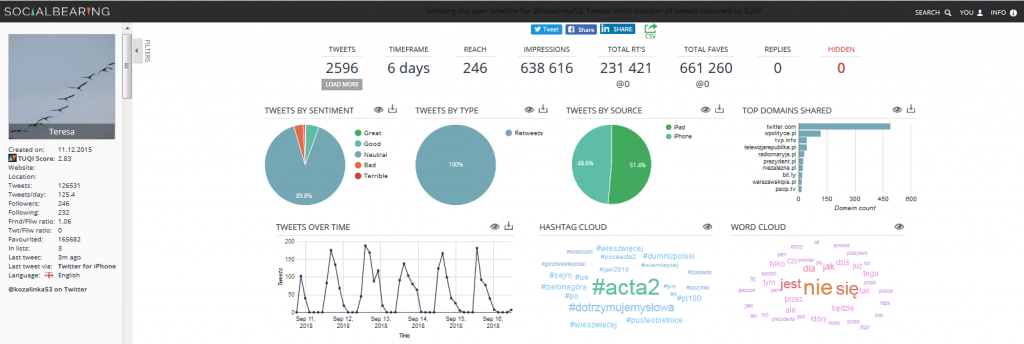

Inne, wciąż aktywne konto działające na rzecz PiS, nosi nazwę @kozalinka53, istnieje od grudnia 2015 roku, wygenerowało 126531 tweetów, a w ostatnich sześciu dniach – 2596 tweetów, czyli średnio 432 tweety dziennie, i są to same re-tweety, nie ma żadnej własnej aktywności. Teoretycznie jest możliwe, że takie konto obsługuje człowiek, który non stop podaje dalej czyjeś tweety – ale nawet jeśli, to jego wpływ w sieci jest dokładnie taki sam jak automatycznych kont. A przecież chodzi właśnie o oddziaływanie, a nie o to, czy udało się czynność podawania dalej zautomatyzować, czy też wciąż klikaniem zajmuje się człowiek.

Warto przy tym wiedzieć, że zarządzający botami programiści mogą w każdej chwili zrezygnować z automatyzacji konta, a wtedy – np. dla udowodnienia, że wcale nie mamy do czynienia z botem, pojawia się na nim kilka zwyczajnych wpisów. To nie zmienia jednak ogólnego jego zachowania. Z tego powodu jednak naukowcy zajmujący się botami ostrożnie je opisują, wskazując głównie na charakterystyczną strukturę ich aktywności, poza tym mówią również o cyborgach – czyli kontach łączących aktywność maszyny i człowieka, oraz ogólnie o kontach fake`owych, czyli takich, za którymi nie stoi zwyczajny, nieopłacany użytkownik social media. Są ich miliony. Jak podawała niedawno Gazeta Wyborcza, wg najnowszych danych na Facebooku istnieje nawet 90 mln fałszywych kont, na Twitterze – do 10 mln. Większość jest wykorzystywana w biznesie, nie w polityce.

Potrzebujemy jawności w korzystaniu z narzędzi internetowych w kampanii

W polskiej sieci jest też wiele uśpionych botów, które obserwują czołówkę polskiej sceny politycznej. Nowe fermy botów pojawiające się co jakiś czas obserwuję od listopada 2017 zarówno u prezydenta Andrzeja Dudy, Donalda Tuska, Grzegorza Schetyny, jak i Janusza Korwin-Mikkego, innych krajowych polityków czy znanych publicystów. Są wśród nich konta zarówno polskie, jak i zagraniczne (np. ferma chińskich botów z wiosny 2018). W lipcu, gdy Twitter oficjalnie zapowiedział, że usuwa fake’owe konta, w Polsce Jerzy Buzek stracił 2,97 proc. fanów, Andrzej Duda – 0,89 proc., a np. Ryszard Czarnecki – 1,24 proc.

To jednak nie w narzędziach leży główny problem dotyczący polskich kampanii wyborczych. Nowoczesne narzędzia internetowe są i będą używane. Najważniejsze jest, by nie służyły do manipulacji wyborcami. A to oznacza jawność ich wykorzystania, która powinna być zapisana w Kodeksie Wyborczym. Podczas prac nad kodeksem konieczne będzie ustalenie, które narzędzia są dopuszczalne, a które nie.

- Czy zgodzimy się jako społeczeństwo na boty, czy też uznamy, że są na tyle nieetyczne, iż nie mogą służyć do przekonywania wyborców?

- A co z kupowaniem fanów lub lajków?

- Jeśli jest to dopuszczalne, w jaki sposób my jako użytkownicy social media powinniśmy się o takiej praktyce dowiadywać?

- Co z sytuacją, gdy reklamę wyborczą finansuje ktoś z zewnątrz, np. z innego państwa – a może się to dziać nawet bez wiedzy osoby reklamowanej?

Taka dyskusja w Polsce się jeszcze nie odbyła, choć pilnie jej potrzebujemy.

Artykuł opublikowany na Oko.Press